从获取OpenAI API key到Ollama本地部署:Cherry Studio 全栈AI工作站底层架构与生态战略分析

Cherry Studio 全栈AI工作站深度解析:多模型集成、MCP协议与本地RAG实战指南

在2026年的生成式AI生态中,大语言模型已高度专业化:GPT系列擅长综合逻辑,Claude主导代码与长文本,Gemini 3.1 Pro 凭借百万上下文和多模态能力占据研究高地,Grok 4 则在实时数据与无审查场景表现出色。没有单一模型能通吃所有领域,用户被迫在不同平台间频繁切换。

Cherry Studio 正是在这一背景下诞生的桌面级“全栈AI工作站”。它不是简单的网页封装工具,而是跨平台AI大模型统一控制器。通过抽象统一接口,它无缝集成云端前沿模型、本地Ollama/LM Studio 离线环境,以及 Perplexity、Poe 等网络检索服务,真正实现云端算力、本地零成本推理与实时互联网数据的超级聚合。

一、开箱即用的生产力起点

Cherry Studio 内置智谱 GLM-4.5-Air(MoE架构、128K上下文、高速生成)和阿里 Qwen3-8B(119种语言+原生思维链),用户无需配置 OpenAI API Key 即可直接体验工业级AI能力。这极大降低了入门门槛,成为开发者、工程师和创作者快速上手的首选。

二、底层架构:Electron + 现代前端的极致平衡

Cherry Studio 采用 Electron 38 + Node.js 22 作为运行时,确保对操作系统底层API的完整访问权限。前端使用 React 19 + TypeScript 5.8,配合 Ant Design 5.27、TailwindCSS v4 和 styled-components,实现 Windows Mica 毛玻璃、深浅色模式无缝切换等高级视觉效果。

全局状态管理选用 Redux Toolkit + redux-persist,持久化层则采用 Dexie(IndexedDB 高级封装),支持百万级对话历史毫秒级检索。富文本编辑器基于 TipTap 3.2 + Yjs CRDT 协议,已为未来多人实时协作预留接口。

三、突破Web沙箱:原生系统级交互

“划词助手”是 Cherry Studio 的杀手级功能——在任意窗口选中文字即可唤起AI翻译、解释或摘要。为实现跨平台全局钩子,团队使用 C/C++ 编写原生插件:在 Linux 下调用 libevdev、libxtst、X11/Wayland;在 Windows 下要求开发者模式并开启符号链接权限。这些底层设计充分体现了“为极客而生”的产品哲学。

四、多模型并发与动态思考机制

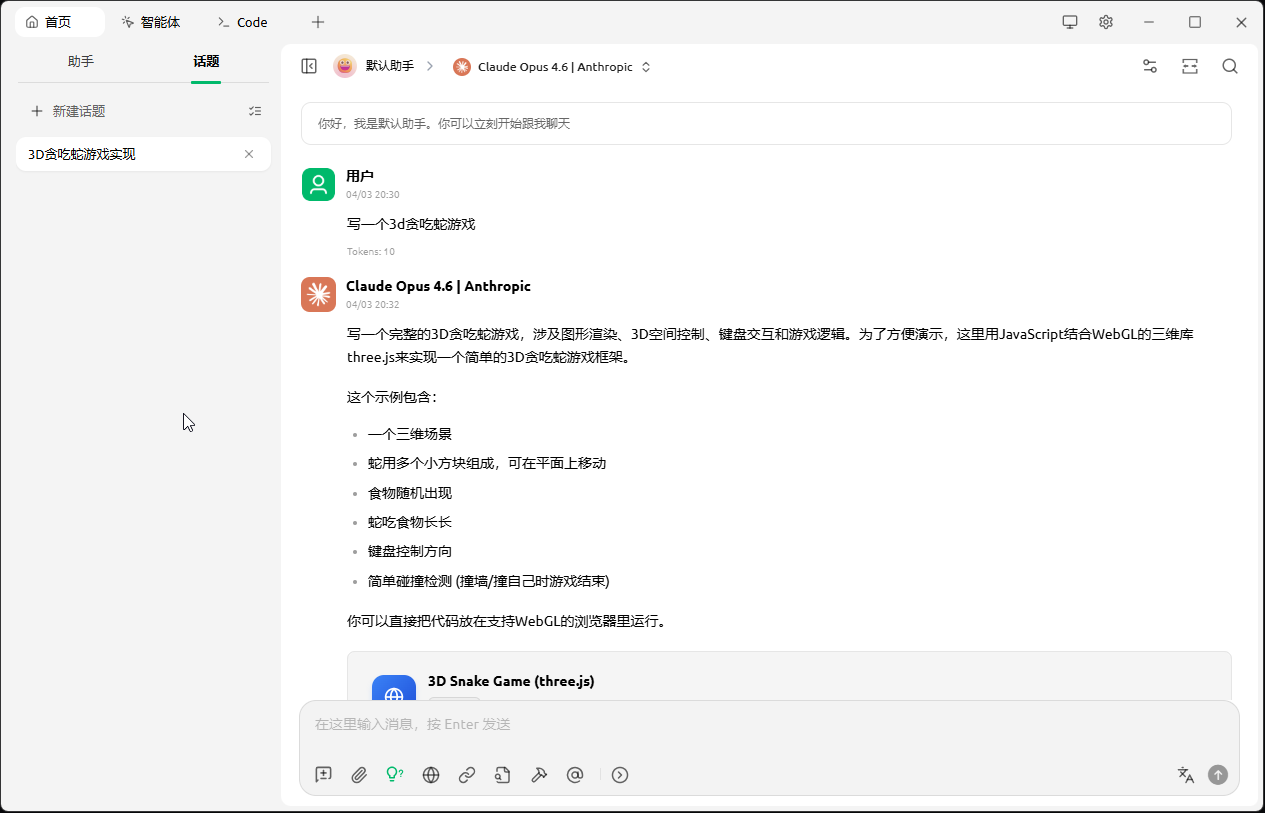

核心亮点是“多模型同时对话”:同一个问题可同时发给 Grok 4、Claude Opus 4.6 等模型,通过并行对比快速消除幻觉,实现交叉验证。

@cherrystudio/ai-core 引擎支持 Thinking Mode、Token预算控制和模型ID标准化处理,让不同供应商的API差异被完全抹平。

五、本地RAG知识库:打造私有第二大脑

用户可拖拽PDF、DOCX、文件夹或网页链接构建本地知识库。文本经清洗、分块后使用 bge-m3 等嵌入模型向量化,整个过程完全在本地完成,彻底杜绝隐私泄露风险。

查询时向量片段自动注入上下文,并附带精确引用来源,支持点击溯源。v1.8.4 已开放 REST API,可作为局域网知识问答微服务。

六、Code Agent:从辅助到执行级副驾驶

v1.5.7 推出的 Code Agent 让 Cherry Studio 进入软件工程领域。

系统为 Agent 构建独立 Node.js 沙箱环境,自动注入 API Key、Proxy 等变量,并在UI内弹出原生终端接管输入输出。支持 Claude、Gemini、Qwen3 Coder 以及 OpenRouter 聚合服务自定义API Key,还原生兼容本地 LM Studio/Ollama。开发者可在本地显卡上零成本完成代码重构,同时通过严格转义与边界检查保障安全。

📢 开发者效率工具推荐:国内获取主流AI大厂Claude Opus 4.6 \ Anthropic、OpenAI \ GPT-5.4 APIKey方案uiuiAPI

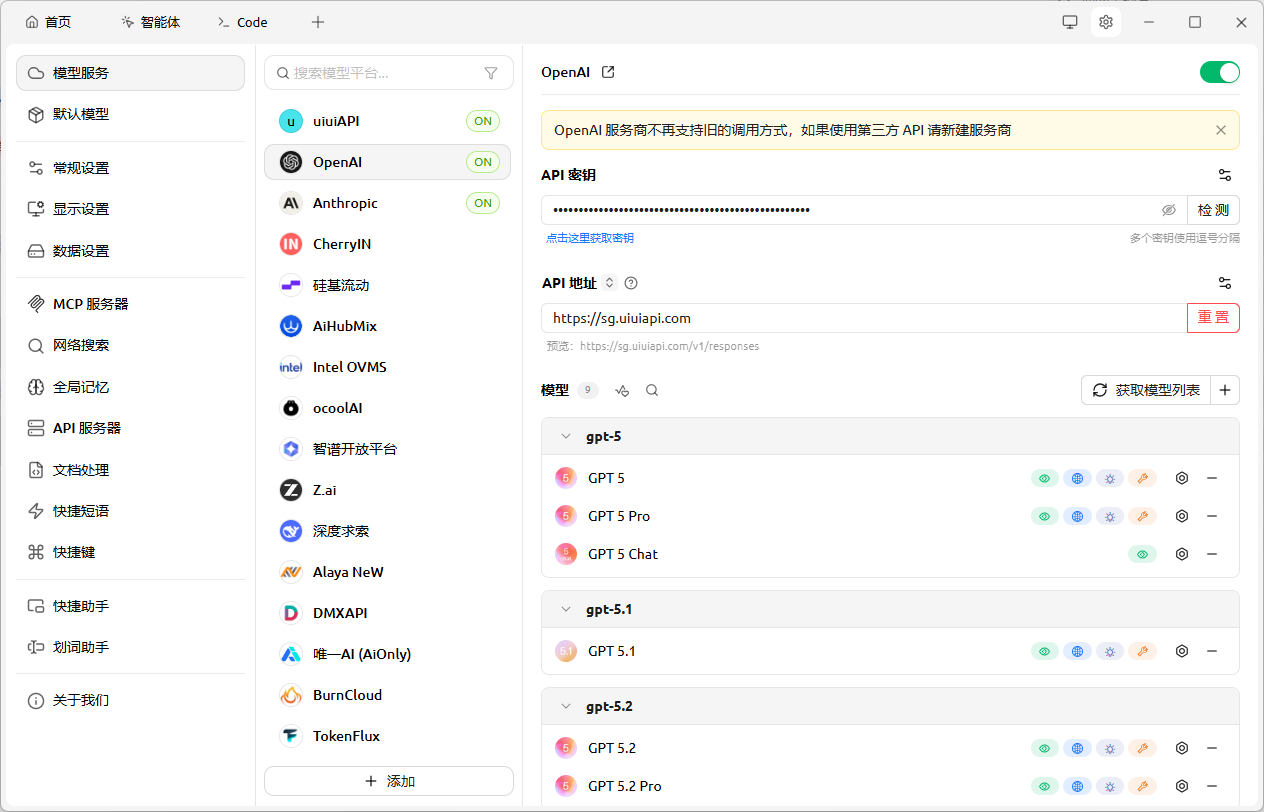

在使用 Cherry Studio 构建全栈工作流时,频繁注册海外服务商、管理繁杂的 API 密钥以及应对网络连通性问题,往往会消耗开发者大量精力。

国内开发者或者AI使用的用户接入 [uiuiAPI] 。作为专业的 API 分发,uiuiAPI 完美契合了 Cherry Studio 的多模型调度需求:

- 全模型覆盖:一个接口、一个密钥,全面兼容 OpenAI、Anthropic (Claude 3.5/3.7)、Google Gemini 等主流大模型协议。

- 极客级稳定:底层采用高可用架构,完美解决廉价中转站常见的文件解析断连、请求超时等痛点。

- 无缝对接:高度兼容 OpenAI 等主流接口规范,在 Cherry Studio 的“提供商设置”中填入 uiuiAPI 的接口地址与 Key,一分钟即可点亮全网顶尖算力。

七、MCP协议:生态级指挥总线

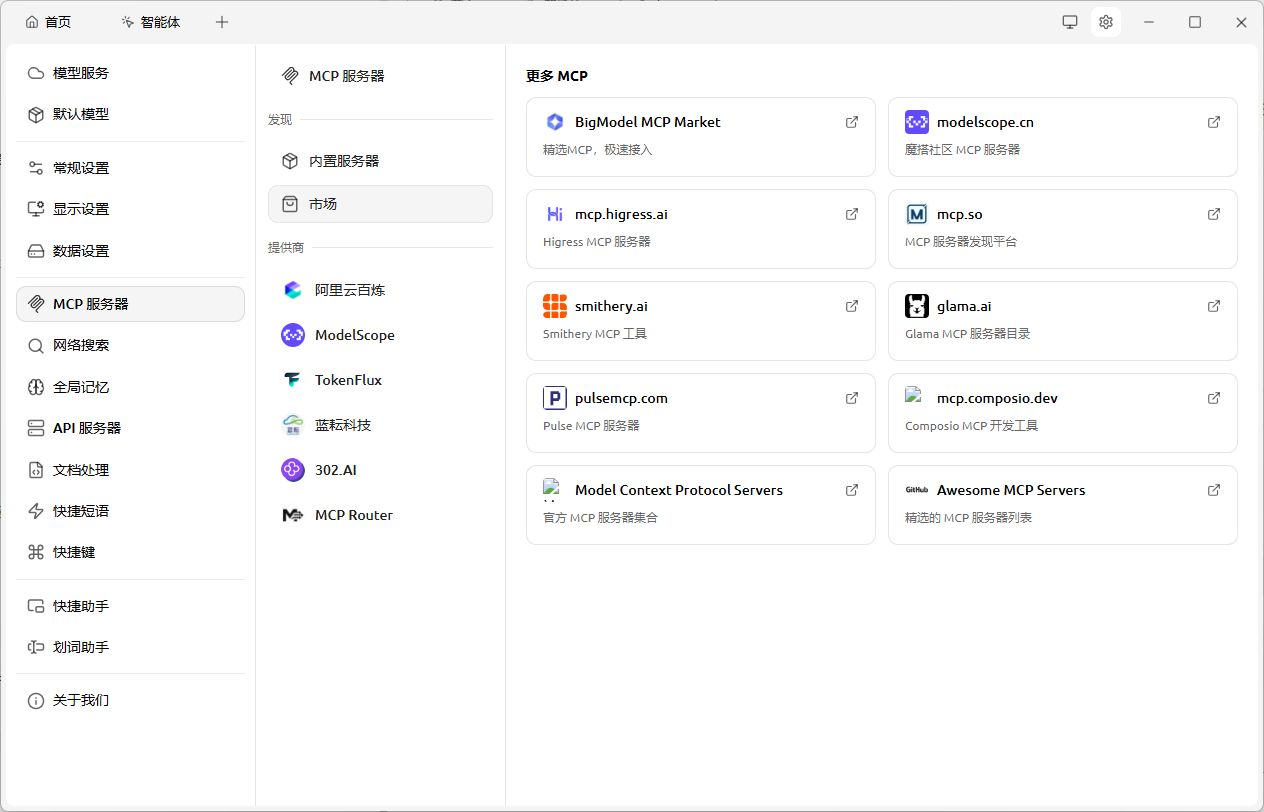

Anthropic 提出的 Model Context Protocol(MCP)将模型“大脑”与外部工具解耦。Cherry Studio 是目前适配最完善的 MCP 客户端,支持 STDIO(本地低延迟)和 SSE(远程云端)两种传输方式。

通过 MCP,外部服务(如日历、Git、数据库、地图API)被抽象为轻量 Server 端点。阿里 Higress 等平台已推出将 RESTful API 自动转为 MCP 的中间件,MCP Marketplace 生态正在快速成型,用户可“一键安装”各种工具链。

八、安全隐私与企业级部署

Cherry Studio 将自己定位为“纯本地管理工具”,严格遵守“三不收集”原则:不回传 API Key、不中继对话内容、仅采集匿名遥测数据。

企业版(Enterprise Edition)提供中央模型路由、RBAC 权限控制、共享知识库与 SLA 支持,完美解决 Token 消耗失控、数据孤岛等问题,适合中大型团队私有化部署。

九、竞品对比与差异化定位

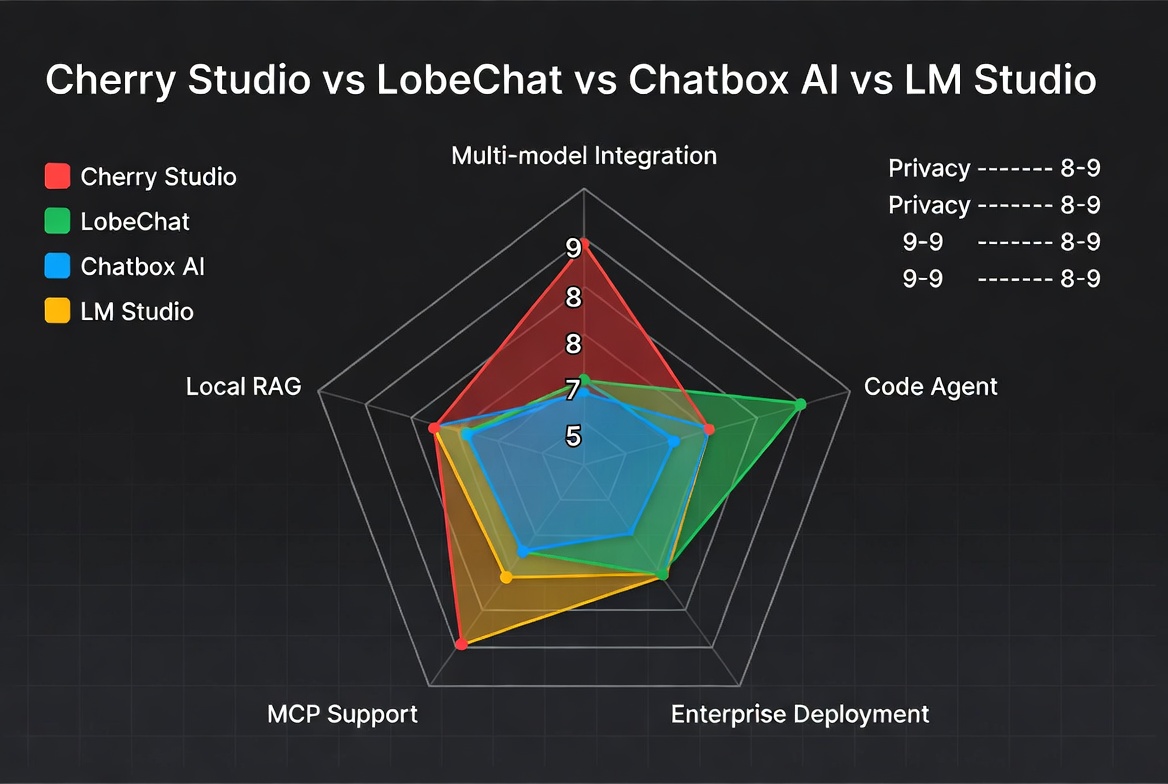

与 Chatbox(极简会话)、LobeChat(插件生态)、LM Studio(纯本地推理)相比,Cherry Studio 在“全栈集成 + MCP 生态 + Code Agent + 企业私有化”四个维度形成压倒性优势。它不是轻量化玩具,而是面向硬核开发者与企业 IT 部门的“AI操作系统总线”。

十、当前局限与未来展望

Electron 架构带来一定内存占用,在超长上下文多任务场景下可能出现 OOM;文件解析依赖外部模型上限,聚合接口偶尔会受限。

官方 Roadmap 显示,下一阶段将重点打造系统级全域记忆(集成 mem0.ai 等)、Deep Research 深度研究引擎,以及移动端(iOS/Android)原生移植。MCP Marketplace 的爆发式增长,将让 Cherry Studio 从桌面工具进化成真正的 AI 指挥中枢。

界智通(jieAGI)总结

Cherry Studio 以极客级架构和前瞻生态布局,解决了 AI 工具碎片化的核心痛点。无论你是需要快速原型开发的独立开发者,还是管理企业级 AI 资产的 IT 架构师,它都值得立刻上手。建议从社区开源版开始体验,感受多模型并行、本地 RAG 与 Code Agent 带来的生产力飞跃。

版权信息: 本文由界智通(jieagi)团队编写,保留所有权利。未经授权,不得转载或用于商业用途。

本文发布于2026年04月03日20:11,已经过了45天,若内容或图片失效,请留言反馈 转载请注明出处: 界智通

本文的链接地址: https://www.jieagi.com/115.html

暂无评论

界智通

界智通  jieagi_Pan

jieagi_Pan

太好看了,快点更新!

国内开发者玩转Claude:最新Claude 4模型解析与API Key获取攻略

这是系统生成的演示评论

国内开发者玩转Claude:最新Claude 4模型解析与API Key获取攻略